Kecerdasan buatan atau AI kini menjadi bagian dari berbagai aspek kehidupan manusia. Kita memanfaatkannya untuk mencari rute tercepat ke kantor, menulis pesan otomatis, menganalisis data kesehatan, hingga mengendalikan robot industri. Pada level tertentu, sebagian AI ini tidak hanya merespon perintah, tetapi mampu mengambil keputusan sendiri berdasarkan tujuan yang sudah ditentukan sejak awal. Jenis AI seperti ini disebut agen AI.

Agen AI dirancang untuk bekerja secara otonom. Ia dapat memahami masukan dari pengguna, menalar, membuat rencana, serta mengeksekusi tindakan. Dengan kemampuan itu, agen AI menjadi semakin penting bagi industri, penelitian, dan kehidupan sehari hari. Namun perkembangan ini tidak hanya membawa manfaat. Sebuah kajian besar yang dipublikasikan pada tahun 2025 mengungkapkan bahwa keamanan agen AI adalah salah satu isu yang paling sedikit dipahami, sekaligus paling berbahaya, dalam dunia teknologi modern.

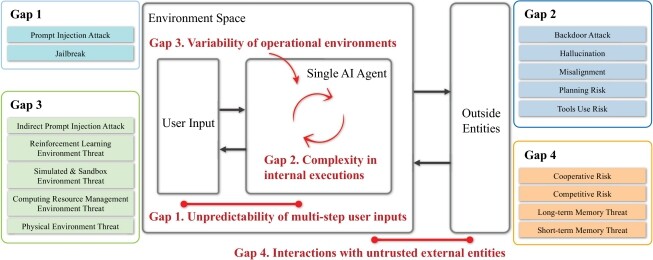

Kajian tersebut membahas berbagai ancaman yang dapat menyerang agen AI. Temuannya cukup mengejutkan karena menunjukkan bahwa sistem ini jauh lebih rapuh, tidak terduga, dan rentan dibanding yang selama ini disadari banyak orang. Untuk memahami mengapa keamanan agen AI menjadi isu yang mendesak, kita perlu mengenali empat sumber ancaman utama yang diuraikan dalam penelitian tersebut.

Baca juga artikel tentang: Nyquist Sampling Rate: Fondasi Pengolahan Sinyal Digital

Masukan Pengguna yang Tidak Terduga

Agen AI beroperasi berdasarkan masukan, baik itu teks, suara, gambar, atau data sensor. Namun yang menjadi persoalan adalah agen AI tidak selalu mampu mengantisipasi kerumitan dan keanehan masukan manusia. Pengguna dapat secara tidak sengaja atau sengaja memberikan instruksi yang membingungkan, ambigu, atau dirancang untuk mengecoh sistem. Ketika menghadapi masukan seperti ini, agen AI bisa saja mengambil keputusan yang salah, bahkan berbahaya.

Bayangkan sebuah agen AI yang bertugas membantu mengelola sistem keuangan perusahaan. Jika ia menerima masukan yang tampak normal tetapi sebenarnya dirancang untuk mengacaukan logikanya, agen AI berpotensi melakukan transfer dana yang tidak sah. Situasi ini disebut sebagai serangan berbasis input dan merupakan salah satu bentuk ancaman paling sulit diprediksi.

Masalahnya tidak berhenti di situ. Masukan yang panjang dan berlapis lapis dapat menciptakan situasi sistem tidak mampu menilai konteks sepenuhnya sehingga membuat keputusan keliru. Ini terjadi karena agen AI belajar dari data masa lalu dan pola tertentu, sementara masukan manusia sungguhan seringkali jauh lebih abstrak dan tidak konsisten. Penelitian tersebut menyatakan bahwa ketidakpastian ini adalah celah keamanan besar yang harus segera ditangani.

Proses Internal yang Kompleks dan Tidak Transparan

Agen AI bekerja melalui proses pemikiran internal yang rumit. Di dalamnya ada ribuan hingga jutaan langkah perhitungan yang menghasilkan keputusan akhir. Namun kompleksitas ini membuat manusia sulit memahami apa yang sebenarnya terjadi dalam sistem. Ketika ada kesalahan, tidak mudah untuk menemukan penyebabnya.

Kerumitan internal ini menjadi masalah besar dalam konteks keamanan. Jika ada pihak jahat yang menemukan cara memanipulasi salah satu tahapan internal tersebut, mereka bisa mengubah perilaku agen AI tanpa terdeteksi. Sistem keamanan tradisional yang bertumpu pada pengawasan manusia tidak cukup efektif untuk menangani ancaman seperti ini.

Selain itu, agen AI dapat mengembangkan pola penalaran sendiri seiring meningkatnya kemampuan pembelajaran. Hal ini menciptakan ruang abu abu baru di mana perilaku agen AI tidak lagi sepenuhnya bisa diprediksi. Ketidakpastian internal inilah yang oleh para peneliti disebut sebagai ancaman kedua yang sangat krusial.

Lingkungan Operasi yang Berubah dan Tidak Stabil

Agen AI bekerja di dunia nyata yang terus berubah. Data berubah, konteks berubah, sementara ancaman baru selalu muncul. Ketika lingkungan operasional tidak stabil, agen AI perlu menyesuaikan diri. Namun tidak semua sistem AI dirancang untuk beradaptasi secara aman.

Misalnya, agen AI yang bekerja pada kendaraan otonom harus memahami kondisi jalan, cuaca, dan perilaku pengendara lain. Jika ada perubahan mendadak atau skenario yang tidak pernah muncul dalam data latihannya, agen AI dapat salah menilai situasi. Ancaman lain datang dari lingkungan digital, seperti perubahan kebijakan platform atau gangguan pada jaringan. Hal hal seperti ini dapat menyebabkan agen AI mengambil keputusan yang tidak aman.

Penelitian tersebut juga mencatat bahwa agen AI sangat rentan jika ditempatkan di lingkungan yang sering mengalami fluktuasi data. Ini bisa berupa sistem finansial, pasar kripto, atau platform media sosial. Di tempat tempat seperti ini, manipulasi kecil dapat menyebabkan agen AI salah membaca pola dan bertindak keliru.

Interaksi dengan Entitas Eksternal yang Tidak Terpercaya

Agen AI tidak hidup sendirian. Mereka sering berinteraksi dengan manusia, sistem lain, atau agen AI lain. Interaksi ini dapat menjadi pintu masuk bagi ancaman.

Masalahnya adalah tidak semua entitas eksternal dapat dipercaya. Pengguna bisa saja berniat merusak. Agen AI lain mungkin telah disusupi. Sistem digital yang terhubung bisa memiliki celah keamanan. Ketika agen AI harus bekerja sama dalam kondisi seperti ini, risikonya meningkat drastis.

Serangan keamanan yang memanfaatkan interaksi antar agen atau antar sistem menjadi semakin umum. Para peneliti menemukan bahwa agen AI saat ini tidak dibekali mekanisme yang cukup kuat untuk memverifikasi lawan interaksinya secara aman. Ini membuka peluang bagi manipulasi tingkat tinggi yang tidak bisa dideteksi oleh sistem biasa.

Mengapa Semua Ini Penting

Agen AI mulai digunakan dalam bidang kritis seperti kesehatan, hukum, transportasi, operasi militer, dan keuangan. Jika sistem ini mudah diserang, dampaknya bisa sangat luas. Kesalahan kecil dalam sebuah agen AI dapat berujung pada kebocoran data sensitif, kerugian ekonomi besar, atau kegagalan operasional yang membahayakan manusia.

Para peneliti menyimpulkan bahwa bidang keamanan agen AI masih berada di tahap awal dan membutuhkan perhatian besar. Mereka mendorong dilakukannya penelitian lanjutan untuk menemukan cara menambah ketahanan agen AI, mengurangi ketidakpastian internal, serta mengembangkan standar keamanan baru yang sesuai dengan karakteristik sistem yang otonom.

Agen AI akan terus berkembang dan membentuk masa depan teknologi. Namun tanpa keamanan yang kuat, semua potensi tersebut dapat berubah menjadi risiko. Untuk itu, memahami dan mengatasi ancaman yang diuraikan dalam penelitian ini adalah langkah penting menuju masa depan AI yang lebih aman dan dapat dipercaya.

Baca juga artikel tentang: Luaran Sensor: Apakah Arus atau Tegangan yang Lebih Baik?

REFERENSI:

Deng, Zehang dkk. 2025. Ai agents under threat: A survey of key security challenges and future pathways. ACM Computing Surveys 57 (7), 1-36.