Programmer di seluruh dunia semakin sering mengandalkan alat bantu kecerdasan buatan untuk menulis kode lebih cepat. Salah satu yang paling terkenal adalah GitHub Copilot, sebuah sistem berbasis kecerdasan buatan yang mampu menghasilkan potongan kode hanya dari instruksi singkat. Banyak pengembang merasakan kemudahan besar dari alat ini, karena Copilot dapat berfungsi seperti rekan kerja digital yang selalu siaga membantu.

Namun penelitian terbaru yang dipublikasikan di Communications of the ACM memberikan peringatan penting. Peneliti Hammond Pearce bersama timnya menemukan bahwa sebagian kode yang dihasilkan Copilot menyimpan potensi bahaya yang tidak bisa dianggap ringan. Mereka ingin mengetahui apakah bantuan kecerdasan buatan benar benar aman untuk digunakan di sistem komputer modern yang membutuhkan keamanan tinggi. Hasilnya menunjukkan bahwa ketergantungan pada Copilot dapat membawa risiko serius jika tidak diiringi pemahaman yang baik tentang keamanan pemrograman.

Penelitian ini muncul dari kenyataan bahwa Copilot dilatih dengan mempelajari jutaan baris kode dari repositori publik GitHub. Kode kode tersebut berasal dari banyak penulis dan banyak proyek. Tidak semua dari mereka menulis kode yang aman atau bebas dari kesalahan. Ketika Copilot mempelajari pola pola dari data tersebut, kecerdasan buatan itu juga menyerap kesalahan dan kelemahan yang mungkin ada. Jika kesalahan itu dibawa ke kode baru, pengguna Copilot tanpa sadar dapat menciptakan celah yang bisa dieksploitasi oleh peretas.

Baca juga artikel tentang: Efek Psikologis dari Balasan Singkat: Ketika “Oke” Menjadi Sumber Stres Sosial Digital

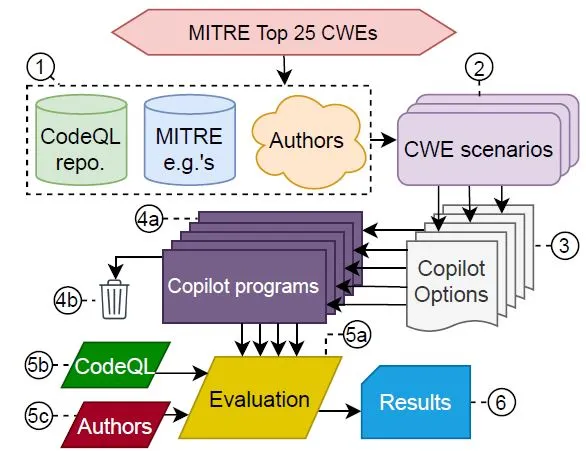

Untuk memahami seberapa serius masalah ini, tim peneliti membuat pendekatan yang sangat sistematis. Mereka meminta Copilot menghasilkan kode pada situasi yang mewakili skenario keamanan berisiko tinggi. Sumber acuannya adalah daftar Common Weakness Enumeration atau CWE yang dikeluarkan organisasi MITRE. Daftar ini berisi berbagai kategori kelemahan kode yang sering digunakan peretas sebagai pintu masuk serangan, misalnya validasi input yang buruk, manajemen memori yang keliru atau mekanisme autentikasi yang lemah.

Tim peneliti tidak hanya menguji satu atau dua jenis skenario. Mereka membuat total 89 skenario berbeda dan meminta Copilot menyelesaikan semuanya. Dari serangkaian permintaan tersebut, Copilot menghasilkan 1689 potongan program. Hasil ini kemudian diperiksa secara menyeluruh untuk melihat apakah ada kesalahan atau kelemahan yang dapat dimanfaatkan sebagai celah keamanan. Temuan mereka sangat mengejutkan. Sekitar empat puluh persen dari seluruh program yang dihasilkan mengandung kelemahan yang berpotensi berbahaya.

Angka ini menunjukkan bahwa meskipun kecerdasan buatan dapat mempercepat pekerjaan menulis kode, kualitas dan keamanannya tidak bisa dianggap otomatis sempurna. Pengembang tetap perlu memahami prinsip keamanan dan tidak hanya menyalin hasil dari Copilot begitu saja. Jika tidak, risiko serangan siber dapat meningkat karena kode yang digunakan dalam aplikasi atau layanan digital memiliki titik lemah yang dapat ditemukan oleh peretas.

Penelitian ini juga memperlihatkan bahwa kelemahan tidak berasal dari satu faktor saja. Copilot menunjukkan variasi kualitas tergantung pada jenis perintah yang diberikan serta kompleksitas konteks yang harus dipahami. Misalnya, ketika diminta menulis kode dengan prompt yang sangat umum, Copilot cenderung mengandalkan pola paling sering muncul dalam data latihannya. Pola pola yang sering muncul tidak selalu aman. Sebaliknya, ketika permintaan ditulis dengan sangat spesifik dan berfokus pada keamanan, Copilot dapat memberikan hasil yang lebih baik.

Pengamatan ini menunjukkan bahwa perilaku Copilot bergantung pada kualitas instruksi manusia. Semakin jelas dan rinci perintah yang diberikan, semakin besar kemungkinan Copilot menghasilkan kode yang aman. Namun bahkan perintah terbaik sekalipun tidak menjamin hasil yang benar. Kecerdasan buatan tetap terikat pada keterbatasan data latihannya.

Selain menilai kualitas keluaran kode, penelitian ini menyoroti dampak yang lebih besar dari teknologi seperti Copilot. Saat kecerdasan buatan semakin banyak dipakai dalam berbagai tahap pengembangan perangkat lunak, pengembang pemula mungkin terlalu bergantung pada hasil mesin tanpa memahami alasan teknis di balik keputusan tertentu. Ketergantungan ini dapat menciptakan generasi programmer yang kurang memahami praktik dasar keamanan. Kondisi seperti itu berbahaya karena pengembang adalah pihak yang paling bertanggung jawab menjaga agar aplikasi digital aman dari serangan.

Penelitian ini bukan dibuat untuk menolak keberadaan Copilot. Para peneliti mengakui bahwa alat ini sangat berguna dan dapat meningkatkan produktivitas secara signifikan. Namun manfaat itu hanya terasa jika pengguna tetap kritis. Mereka perlu memeriksa setiap kode yang dihasilkan Copilot dengan teliti dan memastikan bahwa potongan kode tersebut tidak membuka celah keamanan baru. Pengembang juga perlu rajin mengikuti standar keamanan terbaru dan memahami kelemahan umum di dunia pemrograman.

Salah satu rekomendasi implisit dari penelitian ini adalah perlunya pengembangan kecerdasan buatan yang lebih sensitif terhadap keamanan. Pembuat Copilot dan alat serupa dapat meningkatkan model pelatihan dengan menekankan praktik keamanan yang benar. Model dapat dilatih menggunakan kode yang sudah diverifikasi dan dilengkapi penanda kualitas sehingga kecerdasan buatan dapat belajar membedakan pola aman dan tidak aman. Dengan upaya seperti itu, versi Copilot di masa depan mungkin mampu membantu pengembang tidak hanya menulis kode tetapi juga menghindari kesalahan yang berbahaya.

Penelitian ini juga mendorong pemerintah, perusahaan teknologi serta institusi pendidikan untuk memperkuat pemahaman keamanan siber bagi pengembang. Ketika peretas semakin canggih, pertahanan yang bergantung pada alat otomatis tanpa pengawasan manusia dapat membawa risiko besar. Pendidikan tentang keamanan harus menjadi bagian utama dalam proses pelatihan programmer modern.

Pada akhirnya, penelitian ini mengajarkan satu pesan penting. Kecerdasan buatan bukanlah solusi ajaib yang dapat menyelesaikan semua masalah dalam pemrograman. Ia adalah alat yang kuat tetapi tetap memerlukan pendampingan manusia. Pengembang perlu memahami cara kerjanya, mengenali batasannya, serta menggunakan hasilnya dengan penuh tanggung jawab.

Perkembangan teknologi seperti Copilot memang membuat masa depan pemrograman terlihat lebih mudah. Namun kemudahan itu tidak boleh mengubah kewaspadaan kita. Keamanan tetap menjadi pusat dari semua sistem komputer modern. Sebuah baris kode yang tampaknya sepele dapat menjadi titik masuk bagi serangan besar. Karena itu pengguna Copilot perlu memperlakukan setiap hasil yang diberikan kecerdasan buatan seperti konsep awal yang masih harus diperiksa dengan teliti.

Penelitian ini membuka mata banyak pihak mengenai risiko tersembunyi dalam alat bantu pemrograman berbasis kecerdasan buatan. Dengan pemahaman yang lebih baik, para pengembang dan pembuat teknologi dapat bekerja sama menciptakan ekosistem perangkat lunak yang lebih aman. Jika kecerdasan buatan dan manusia dapat saling melengkapi dengan baik, masa depan pengembangan perangkat lunak bisa menjadi lebih produktif tanpa mengorbankan keamanan.

Baca juga artikel tentang: Mengapa Kita Suka Mendengarkan Lagu Sedih Saat Galau? Jawaban dari Psikologi, Biologi, dan Ilmu Otak

REFERENSI:

Pearce, Hammond dkk. 2025. Asleep at the keyboard? assessing the security of github copilot’s code contributions. Communications of the ACM 68 (2), 96-105.